שלום כולם, וברוכים הבאים לאלישע והזוויות, עונה שניה, פרק שלישי. היום ה-25 ליוני 2024, י"ט תמוז התשע"ד.

את הפרק של היום אני רוצה לפתוח דווקא לא בבינה מלאכותית, אלא בסיפור מעולם החיות התבוניות, וספיציפית חיה בשם האנס הנבון. הסיפור הזה הציב בזמנו חידה בפני הרבה אנשים, חידה שלקח כמה שנים לענות עליה. אני רוצה לקוות שתהיה לכם סבלנות לחכות עד סוף הפרק לשמוע את פתרונה - ולמי שמכיר את הסיפור - בבקשה לא להרוס. אל תגלו.

האנס הנבון היה - סוס. בתערוכות שהחלו קצת אחרי תחילת המאה הקודמת והובלו על ידי מאמנו, וילהלם פון אוסטן, הדגים האנס באופן מתמיד את מה שנראה כאינטליגנציה “אנושית” על ידי מענה לשאלות. פון אוסטן היה שואל אותו שאלות, והאנס ענה בנקישות פרסה, לפי ההוראות שהמאמן נתן לו. נניח, הוא נשאל שאלות בחשבון ופתר אותן. ולא, לא רק שאלות כמו שתיים ועוד שתיים, אלא אפילו שאלות כמו "חשב לי את השורש הריבועי של המספר 4". גם היו שאלות שאינן מתמטיות - פון אוסטן היה מתאים לכל אות בשפה מספר, ומבקש מהאנס לאיית את השם שלו בכך שהיה נוקש בפרסתו את הקוד של האותיות הרלוונטיות. בשיטה זו, האנס הפליא הן את הציבור הרחב והן את החוקרים המובילים של אותה תקופה, והציף במוחם של אנשים את האפשרות שאולי המין האנושי איננו החיה האינטלגנטית ביותר בעולם. אולי סוסים הם חכמים כמונו, וכל שעומד ביננו לבין תקשורת עם אינטלגנציה גבוהה שאיננה אנושית הוא מחסום השפה בלבד.

ככל שהאנס התפרסם, הוא משך אליו גם תשומת לב של חוקרים ידועים, ופון אוסטן הסכים שיבואו ויבחנו את הסוס בעצמם. ממה שיצא לי לקרוא בנושא, לא נראה שפון אוסטן היה רמאי או משהו כזה - הוא פשוט היה נלהב מכך שהסוס שלו כל כך חכם, ושהוא הצליח ללמד אותו כל כך הרבה, ולכן שמח להציג זאת בכל מקום ובפני כל מי שיבקש. בסוף, היתה כאן חידה: אם האנס באמת מסוגל להציג אינטלגנציה באופן כה משכנע, נראה שזה מוכיח שהוא תבוני במובן האנושי של המילה, לא? ומצד שני, אם הוא לא באמת כזה חכם, אז איך הוא מסוגל לענות על מגוון שאלות שכזה ברמת דיוק כה גבוהה?

החידה הזו טרדה את מנוחתם של אנשי אותה תקופה, עד שהגיעה להכרעה סופית ב-1907. אני משער שאתם גם יכולים להבין איך הסיפור הזה מתקשר לעונה שלנו, שהרי מה שקרה כאן היה דומה מאד למבחן טיורינג, רק עם סוסים במקום מחשבים. וממילא, הסיפור הזה משליך גם על הסיפור של העונה שלנו.

כפי שאמרתי, את ההכרעה לגביי האנס אנחנו נחשוף בסוף הפרק, אבל עכשיו בואו נחזור לשנת 1950, בול באמצע של המאה ה-20, כשטיורינג הציע את מבחן טיורינג שלו לזיהוי של בינה מלאכותית. כפי שהזכרתי בכלליות בפרק הקודם, טיורינג נתן גם תחזית משלו לעמידה ביעד הזה באותו מאמר:

"אני מאמין כי בעוד כחמישים שנה יהיה אפשר לתכנת מחשבים, בעלי קיבולת אחסון של כמיליארד ביטים, כך שיוכלו לשחק את משחק החיקוי כה טוב, עד שלחוקר הממוצע לא יהיה יותר מ־70 אחוז סיכוי לנחש נכון עם מי הוא מדבר לאחר חמש דקות של חקירה"

ההערכות של טיורינג היו קצת אופטימיות. זה לקח בסוף 75 שנה ולא חמישים עד שהגענו לאן שאנחנו היום, ובכל הקשור להערכות קיבולת האחסון שלנו הוא פספס במספר רב של סדרי גודל. מיליארד ביטים זה חצי ג'יגה - בערך הגודל של סרט שתורידו מהאינטרנט, בעוד שמודלים כמו GPT ודומיו דורשים פי אלף ויותר מקום כדי לרוץ. אבל כשמשווים לתחזיות אחרות של אנשים בעבר בנושאים שונים, האמת שההערכה של טיורינג היתה די מרשימה בָּדִיוק שלה. תחשבו שבתקופתו של טיורינג עולם המיחשוב היה ממש בחיתוליו, ושלא היה סיכוי שהוא יכול היה לדמיין את ההיקף של מה שנבנה כאן מאז.

כדי לקשר את המבחן של טיורינג לעקרונות יסוד בעולם ה-AI כיום, בואו נקדיש עכשיו קצת זמן לסקירה מהירה של כמה נקודות ציון בדרך משם לכאן. צעדים שלקחו אותנו משלב החיתולים הזה לצעידה על השטיח האדום של הבינה המלאכותית בחליפות ושמלות נוצצות.

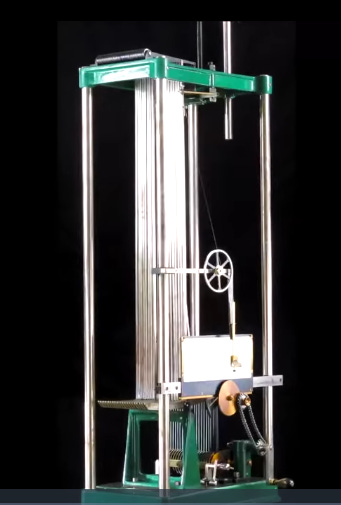

עולם המיחשוב התחיל עוד הרבה לפני טיורינג. אם נגדיר "מחשב" כמכשיר שמבצע חישובים באופן מכני, הרי שדברים כאלו עוד היו במאה התשע-עשרה. אז לא היה מדובר במערכות חשמליות אלא מכניות - כלומר שכל החישובים נעשו על ידי ארגון גאוני של רכיבים פיזיים ואינטראקציות פיזיקליות ביניהם. נניח, בסוף המאה ה-19 פיתח אלברט מיכאלסון, יליד פולין שהיגר לארצות הברית, מכשיר שהיה מסוגל לחשב את טרספורם פורייה, אחד הכלים האנאליטיים הכי משמעותיים בתחום עיבוד האותות. מדובר היה במכשיר מכני לגמרי, שהשתמש בגלגלי שיניים, קפיצים, מטוטלות ועוד מרכיבים כדי לחשב סינוסים וקוסינוסים באופן אוטומטי.

אני מצרף כאן לינק לסרטון למי שרוצה לראות איך זה עבד - גם אם אין לכם מושג מה זה טרנספורם פורייה, יש הנאה בלראות את המכשיר הזה עושה… משהו… באופן אלגנטי. בכל אופן, רק מאוחר יותר, בערך בתקופה של מלחמת העולם השניה, החלו לצוץ להם מחשבים דיגטלים מבוססי אותות חשמליים - וגם שם, הזרימה החשמלית פשוט החליפה את כוחות הכבידה, החיכוך וכדומה. במונחים המודרנים, אפשר לומר שכל המחשבים של אותה התקופה היו מבוססי חומרה בלבד. כמו שאתם לא יכולים לקחת סכין ולהפוך אותו לתרווד, כך כל מחשב עשה משהו אחד בלבד שהוגדר על ידי המבנה הפיזי שלו.

האמת, גם הדור שלנו זכה להכיר ולהשתמש במחשבים מבוססי חומרה שכאלו, כמו לדוגמה המחשבונים הפשוטים מפלסטיק, כאלו שקונים לילדים היום בחנויות צעצועים כשהם עולים לכיתה א', ושכל מה שהוא יודע לעשות זה חשבון פשוט. סיקרן אותי אז בדקתי - המכשיר הראשון מהסוג הזה יצא ב-1971, במחיר שווה לכל נפש של $395, לא פחות, והיה נחשב מוצר יוקרה לזמן מה.

היכולות של המחשבון שיצא ב-1971 נקבעו כולם על פי החומרה שלו, ולגביי המכונה שחישבה את טרנספורם פורייה במאה ה-19 עם מטוטלות וקפיצים אין בכלל שאלה שכך זה היה. אבל בשלב הבא, לצד החומרה, הופיעה לה התוכנה. החומרה נשארה יציבה, אבל נבנתה כך שאפשר היה להתקין עליה תוכנות שונות, כשכל תוכנה יכלה לבצע פונקציות אחרות בתכלית. ריבוי תוכנות שרצות במקביל על גביי חומרה אחת, שדרוגים תכופים לתוכנות שמשפרות את הפונקציונליות בקלות יתירה, ועוד ועוד - כל אלו התאפשרו על ידי ההפרדה הזו שבין חומרה לתוכנה. כמובן, כדי לאפשר את השינוי הזה נדרשו תגליות וחידושים מהפכניים באופנים שבהם בונים חומרה, בהמצאת תחום שלם של שפות תכנות שבהן כותבים תוכנות, ועוד ועוד.

כשנפנה את מבטנו אל התוכנות הללו, נבין מיד שאפשר לקטלג אותן לפי כל מני פרמטרים, ולצרכים שלנו אני רוצה להתמקד בציר אחד: קו התפר, או מערכת היחסים, שבין התוכנה לבין הדאטה שהמשתמש מכניס למערכת, ועד כמה התפקוד של התוכנה תלוי ומושפע מהדאטה הזה. בקצה האחד מצויים תוכנות שבהן התוכנה מגיבה לדאטה של המשתמש באופן נקודתי, בשעת השימוש, ולא מעבר לזה. דוגמא לתוכנה כזו הינה שוב המחשבון הפשוט, שיודע לפתור שאלות במתמטיקה על ידי נוסחאות ידועות. המחשבון הזה, כמובן, עובד בדיוק אותו הדבר בכל מחשב וכל סמארטפון שהוא מותקן עליו - אם הוא היה נותן תשובות שונות לכל אחד, נראה לי שכולנו היינו מסירים אותו מהמכשיר שלנו בתחושה שיש לו באג חמור. עוד תוכנה מהסוג הזה היא תוכנת עיבוד תמלילים WORD - כל משתמש אולי מקליד עליה מסמכים אחרים, אבל הממשק זהה בכל מחשב ולא מושפע מן השאלה האם אני מקליד שיר, רומן או טיוטה לפודקאסט.

בקצה השני, לעומת זאת, ישנן גם מערכות שמתבססות על הדאטה שמגיע מן המשתמש ומן העולם, ושדווקא הדינמיות הזו שלהן היא החוזקה שלהם. תחשבו נניח על חיפוש בגוגל - יש שם שכבה מתוחכמת של תוכנה שעוזרת למצוא ולהציג תוצאות חיפוש, אבל התוצאות שהיא תציג מושפעות מצד אחד מהיסטוריית החיפוש של המשתמש ומצד שני מן המידע שקיים שם בחוץ - למה שמסד הנתונים הענק הזה שקוראים לו האינטרנט מספק לגוגל. דוגמה נוספת שמוכרת לכולנו היא שירות כמו נטפליקס - התכניות והסרטים שאנחנו בוחרים לצפות בהן היום עוברות ניתוח אוטומטי שמתוכו תגזור האפליקציה באילו שידורים נרצה לצפות מחר. מה שנטפליקס תציע לי יהיה שונה ממה שהיא תציע לכם - ובניגוד למה שהיה עם אפליקציית המחשבון, במקרה הזה אנחנו שמחים שזה כך.

וכאן בדיוק מגיע לו החיבור לבינה מלאכותית. שכן מה יש לנו בעצם שם, בתוכנות הללו של גוגל ונטפליקס? תוכנות מחשב שיודעות להסתכל על דאטה, ולהתאים את ההתנהגות שלהן לפי הדאטה הזה. ותגידו - כשבני אדם עושים משהו כזה - רואים מציאות, מחשבים מסלול מחדש ומתאימים את עצמנו אליה - מה אנחנו קוראים לתהליך הזה? אנחנו קוראים לזה - לחשוב. אדם שיודע להתאים את עצמו באופן מרשים ויעיל לדברים שהוא רואה סביבו ייחשב אדם נבון, וככל שההתאמות יעלו באיכותן גם נחשיב את תבונתו יותר. ולכן באופן אינטואטיבי אפשר להבין את אותו אחד שיציע שמערכות שיכולות לעשות דברים כאלו הינן תבוניות.

בואו נפרט זאת קצת יותר. שני כלים אנאליטיים חזקים שיש לנו כבני אדם הינם אינדוקציה ודידוקציה. אינדוקציה הינה התהליך של זיהוי דפוסים מתוך פרטים וניסוח כללים בהתאם לדפוסים הללו, בעוד דדוקציה הינה התהליך של הפעלת הכללים הללו על מקרים פרטיים והסקת מסקנות אופרטיביות. דוגמה לאינדוקציה היא לראות כל יום במשך חודש שהשמש עולה בבוקר ושוקעת בלילה ולהסיק שזהו כלל, חוק טבע שימשיך גם הלאה. דוגמה לדדוקציה היא להשתמש בכלל שהשמש עולה כל בוקר במזרח כדי להסיק שמחר, בעוד כמה שעות, קרני השמש ימצאו את דרכן לתוך החדר שלי דרך החלון המזרחי, יחדרו את הוילון ויעירו אותי משנתי.

שתי היכולות הללו, אינדוקציה ודדוקציה, מרגישות לנו באופן טבעי חלק ממה שהופך מישהו לנבון. בנוסף, תשמחו לשמוע שבמהלך מבחן טיורינג אפשר גם לבדוק את היכולות הללו של המרואיין. פשוט שואלים את הדמות המסתורית בצד השני של הצ'אט שאלות מתאימות: נניח, נותנים לה סדרת מספרים פשוטה ובודקים אם היא מסוגלת לזהות את הדפוס החוזר על עצמו באינדוקציה. לחילופין, אפשר לשאול אותה חידה שדורשת יישום של ידע כללי קודם על מקרה פרטי, באופן שידגים דדוקציה. ולכן, גם מתוך האינטואיצה שלנו שאלו יכולות תבוניות, וגם בשל הרצון לעבור את מבחן טיורינג, לא יפתיע אותנו לגלות שהרבה מערכות AI מנסות להטמיע את היכולות הללו בתוכן. (במאמר מוסגר גם אגיד כאן לאלו מכם שמגיעים מתחום ה-AI, אם במקרה לא חשבתם על זה בעבר: אפשר לחשוב על דדוקציה כמקבילה הלוגית לתהליך ה-Forward Propagation, בעוד אינדוקציה היא המקבילה הלוגית ל- Backward Propagation. אני מניח את זה כאן שתחשבו על זה, וממשיכים.)

אם כבר הכנסנו כאן לשיחה שני מונחים חדשים, אז בואו נוסיף עוד אחד, עוד מילה שאפשר להשתמש בה כדי לתאר עיבוד של מידע חדש לתוך ידע קיים: למידה. כשתינוק יוצא מהרחם, המוח שלו ריק מִיֶדע על פריז ופלנטות ורפואה מתקדמת. לאורך החיים שלו הוא ייפגש כל הזמן עם המציאות שסביבו וילמד דברים חדשים, מה שיאפשר לו להתמודד טוב יותר עם הסביבה. וגם כאן, כמו עם אינדוקציה ודדוקציה, בואו נשאל - איך זה מתכתב עם מבחן טיורינג? ובכן, בלי יכולת למידה בסיסית זה די צפוי שאף מחשב לא יוכל לעבור את מבחן טיורינג, שכן אם בתחילת השיחה סיפרתי לו שאני אלרגי לבוטנים, בלי למידה כלשהי הוא יכול בטעות לשאול אותי מיד לאחר מכן אם אני אוהב במבה, ולגלות בכך באופן די בוטה שהוא מחשב ולא אדם. (ורק לפרוטוקול - אני דווקא אוהב במבה, מאד, אז אם מישהו רוצה לשלוח לי איזו שקית, מוזמן!).

בתחילת הפרק קצת קטלתי את טיורינג על זה שהוא היה אופטימי מדי בתחזיות שלו לגביי עמידה במבחן שתיאר. אבל שמעו, הבנאדם היה גאון ובעל חזון, ואת התובנה הזו, של חשיבות יכולת הלמידה, הוא תיאר כבר אז. יותר מכך - הוא הציע שזו תהיה התשתית לבניית מכונה שתצליח לעבור את המבחן שלו. בשיחה שהעביר לכמה מלומדים ב-1951 אבל שמעולם לא פורסמה, עד שנמצאה בכתביו לאחר מותו, הוא אמר את הדברים הבאים - אני מצטט קטעים נבחרים כאן עם כמה דילוגים:

אילו היתה המכונה מסוגלת באיזה אופן "ללמוד מהניסיון" היה הדבר מרשים הרבה יותר. אם אמנם כך יהיה, אין כל סיבה שלא להתחיל ממכונה פשוטה יחסית, ולהפוך אותה, על ידי חשיפתה ל"ניסיון" מתאים, למכונה מורכבת יותר, המסוגלת להתמודד עם מגוון רחב יותר של מקרים. תהליך זה ניתן אולי להאיץ על ידי בחירה מתאימה של החוויות אליהן היא נחשפת. ניתן יהיה לכנות תהליך שכזה "חינוך", ואני מציע להפקיד את חינוכה של המכונה בידי מורה בית ספר מוכשר ביותר, המתעניין בפרויקט.

מה שטיורינג מתאר כאן הוא את תהליך האינדוקציה שדיברנו עליו קודם: למידה מהנסיון, חילוץ כללים מנחים מתוך אוסף פרטים. בהמשך, הוא אף משתף מחשבות שהיו לו לגביי איך תהליך הלמידה הזה יתרחש בפועל, ואני אקריא לכם עכשיו כאן את הציטוט שלו בעניין. לאלו מכם שיודעים איך מערכות AI מאומנות כיום - "אימון" זה המונח המודרני למה שטיורינג קרא לו "חינוך" - אם הפה שלכם פתוח, אל תסגרו אותו, כי אתם בכל אופן עומדים לפעור אותו שוב. וככה הוא אמר ב-1951:

אני מציע שיהיו שתי מערכות שאותם יוכל להפעיל המורה, ושייצגו את הרעיונות של תענוג וכאב. בשלבים מאוחרים יותר של החינוך תכיר המכונה תנאים אחדים כרצויים, משום שהיו קשורים בעבר עם תענוג, וכן תכיר תנאים אחרים כבלתי רצויים. ביטויים מסוימים של כעס מצד המורה עשויים, למשל, להיות כה מאיימים עד שהמכונה לא תוכל להתעלם מהם, כך שהמורה ימצא שאין עוד צורך "להצליף בה במקל".

כפי שהבטחתי, אלו מכם שמכירים את מערכות ה-AI כיום בוודאי התלהבו למשמע הציטוט הזה, שכן טיורינג חזה כבר אז את אחד המנגנונים שבהם משתמשים כיום לאימון המערכות הללו. לוקחים מערכת ריקה מידע, מציגים לה דאטה ומבקשים שתגיב. נניח, מציגים לה תמונה ושואלים האם יש בה חתול. המערכת מנחשת משהו, ונותנים לה משוב - "צדקת" או "טעית". המערכת לוקחת את המשוב הזה, ומבצעת שינויים בקונפיגורציה הפנימית שלה כדי לחזק את השיקולים שהפעילה איפה שהיא צדקה ולשנות התנהגות במקרים כמו אלו שטעתה בהם, וכך לאורך הרבה דוגמאות שהיא מקבלת, הביצועים שלה משתפרים והולכים. מה שבעצם קורה כאן, אם כן, הוא תהליך של אינדוקציה, של חילוץ כללים מתוך הפרטים - של למידה.

בואו נקשר את הרעיון הזה למה שראינו בפרק הקודם לגביי מבחן טיורינג. אני אדבר כאן מאד בניפנופי ידיים, אבל תזרמו איתי. בואו נניח שהצלחנו לבנות מכונה כזו, ספיצפית אחת שיודעת להשתמש בשפה אנושית וגם להבין שפה אנושית. אז אם אנחנו רוצים שהיא תצליח לעבור את מבחן טיורינג, ככה נעשה את זה: נביא לה הרבה דוגמאות של דיאלוגים בין שני בני אדם, וניתן לה לנחש מה התגובה הראויה בקטע מסויים בשיחה. אם התשובה שלה תהיה משכנעת, משהו שאדם נורמלי היה אומר, ניתן לה מדבקה של כוכב במחברת, נפעיל את מנגנון העונג שעליו דיבר טיורינג, כדי שתדע להתמיד בתשובות כאלו. ואם לא, נשלח אותה לעמוד בפינה בכיתה וגם נגיד לה מה ציפינו שהיא תגיד, כדי שתלמד להבא. ואם נעשה את זה מספיק פעמים, אז כיוון שהיא מכונה שלומדת, לאורך זמן היא תדע איך להישמע כמו בן אנוש. מבחן טיורינג - Here we come!

אבל רגע אחד — מה בדיוק תיארנו כאן כתהליך הלמידה של מערכות AI היום? תיארנו בעצם מבחן טיורינג מתמשך: המערכת מנסה לעבור את המבחן, אם היא מצליחה - אז סיימנו והולכים והביתה, ואם לא - נותנים לה משוב ומנסים עוד סיבוב. במילים אחרות: כל תהליך האימון של מערכות הבינה המלאכותית היום מוכוון לבנייה של מכונות שמסוגלות להתאים את עצמן מספיק טוב לציפיות שלנו. וכשעושים את זה עם מכונה שממוקדת בשיח עם בני אדם, מקבלים מכונה שמתמקצעת במבחן טיורינג.

מגניב, נכון?

בזאת אני מרגיש שפרעתי את החוב מסוף השבוע שעבר, שמקשר בין שני הפרקים.

מש"ל.

אז, מה אנחנו חושבים על הקונספט הזה? אין ספק שהוא מבריק, אבל האם יש לו גם חסרונות או פגמים? יודעים מה - רגע של תזכורת לימי התיכון. זוכרים כשהיינו לומדים למבחן, והיינו מקטרים שזה לא כיף ללמוד, ושאנחנו לומדים רק כדי לעבור את המבחן ולא כדי להבין באמת? זוכרים איך היינו לומדים בשביל מבחנים כאלו?

זה בדיוק מה שקורה כאן. התהליך שתיארתי, של מכונה לומדת, הוא תהליך שבו המכונה נמדדת לא על פי עומק ההבנה שלה, אלא על פי התוצאות שלה במבחן שניתן לה. אמנם, בתור המורים שלה, אנחנו מקווים שהתוצאות הטובות במבחן משקפות הבנה עמוקה של החומר, אבל בשורה התחתונה אנחנו מתגמלים אותה רק על הצלחה במבחן ולא על "הבנה", שזה דבר שקשה יותר למדוד שלא דרך המבחן. ולכן העובדה הזו צריכה לעורר בנו חשש שאולי עובדים עלינו כאן. אולי הלמידה הזו איננה באמת מה שאנחנו חשבנו שהיא.

הדאגה הזו היא במקום, אנשי AI מודעים לה היטב, ואנו ניגע בה שוב לאורך הסדרה. בינתיים, לסיום הפרק הזה, אני רוצה לתת כאן שתי טעימות למקומות שבהן החשש הזה התברר כמוצדק, כשהראשונה שבהן היא, כמובן, הסוס החביב שלנו, האנס הנבון. אתם בטח התקשתם להאזין לכל הפרק כיוון שהסקרנות לגביי האנס כילתה כל תא מוח פנוי, נכון? ובכן הדברים התבררו לאשורן ב-1907 ותועדו בדו"ח של אוסקר פאנגוסט, סטודנט במכון הפסיכולוגי באוניברסיטת ברלין, שביצע אוסף ניסויים עם האנס. הוא הגיע למסקנה כי האנס, למעשה, לא הבין דבר בחשבון ולא ידע קרוא וכתוב. במקום זה, הוא הגיב לרמזים פיזיולוגים עדינים מאוד, כנראה בלתי רצוניים, מצד פון אוסטן והקהל שסבב אותו במופעים שלו. הוא חש מתי המאמן שלו והאנשים סביבו מתחילים להתרגש, ולפי זה ידע מתי לעצור בנקישותיו. הניסויים שהוכיחו את זה היו מאד מעניינים - נניח, הם דאגו לשאול את האנס את השאלות ללא קהל וכשהמאמן שלו מצוי מאחורי פרגוד. אולי הניסוי הכי מגניב ששמעתי עליו היה שדאגו לשאול אותו שאלות, שהשואל לא ידע את התשובה - במצב שכזה, שפת הגוף של השואל לא יכלה לגלות להאנס מתי לעצור. נכון מגניב? כלומר, פחות מגניב ממה שהיה אילו האנס באמת היה יכול לחשוב כמו בני אדם, אבל עדיין מגניב.

ובהשאלה לסיפור שלנו - בשנים שלפני החשיפה הזו, אנשים בטח חשבו שהאנס עובר באופן מדהים את "מבחן טיורינג" לחיות. אפילו המאמן שלו האמין בכך, וגם לאחר שהאמת התגלתה אף אחד לא חשד בו שהוא רימה אנשים במתכוון. אבל למפרע התברר שהאנס אמנם למד משהו - אבל פשוט לא את הדברים שחשבנו שהוא למד. ההצלחה שלו היתה כמו לעבור את המבחן עם שליפים - אין ספק שצריך כישורים מיוחדים לרמות במבחנים, אז אני לא מזלזל ביכולת שלו לקרוא שפת גוף של בני אדם, אבל הלקח מהסיפור הזה אלינו הוא מתבקש: שכאשר מכונה מתיימרת להיות "אינטלגנטית", עלינו לפקוח עליה שבע עיניים ולוודא שהיא זו שמחזיקה באינטלגנציה, ושהיא לא מקבלת רמיזות מפורשות או נסתרות מן הסביבה שלה שמגלות לה את התשובות. וכפי שאמרתי - לאנשי דאטה הבעיה הזו מוכרת מאד, ויש לה הרבה פנים, מזליגת מידע, overfitting, ועוד ועוד, וגם דרכים להתגונן מפניה.

אז זה סיפור אחד - והנה עוד סיפור, קרוב יותר לעולם של בינה מלאכותית. ב-2015 סערה הרשת: גוגל שחררה זמן מה לפני כן פיצ'ר מגניב - אלגוריתם בינה מלאכותית של החברה עבר על תמונות בתוך גוגל Photos, ובאופן אוטומטי תייג כל מני ישויות שם. נניח, מתייג בכל תמונה את החתולים, את המכוניות, וכן הלאה. אחלה פיצ'ר, נכון?

אז על מה קמה הסערה? היא קמה כאשר בחור אפרו-אמריקאי בשם ג'קי אלסין (Jacky Alciné) כתב בטוויטר שהוא הזדעזע לגלות שהאלגוריתם סימן תמונות שלו ושל בן זוג שלו כ… גורילות. "אתם פספסתם כאן בגדול, גוגל - הבן זוג שלי איננו גורילה!" הוא זעם.

עכשיו, כמובן שאף אחד לא חשב אז ולא חושב היום שגוגל בכוונה החליטו לקטלג אנשים אפרו-אמריקאים כגורילות. גוגל פשוט לא שמו לב לבעיה שנוצרה כדרך אגב מתוך העבודה שלהם על האלגוריתם.

וגם כאן, שורש העניין הוא זהה למה שקרה עם האנס הנבון. גוגל הציגו המון תמונות מתוייגות למערכת הבינה המלאכותית שלה, וקיוו שהיא תבין לבד איך לזהות חיות שונות. כמובן, "תבין לבד" מחביא מאחוריו המון תחכום ותובנות עומק על איך בונים משהו כזה, אז אני לא מנסה למזער את הגאונות שבמערכת הזו. אבל בשורה התחתונה, זה מה שהיה. הם קיוו שהמכונה תלמד לזהות גורילה באופן מדוייק. הרי בני אדם לא מבלבלים ביניהם, אז למה שהיא תטעה? וחיות אחרות היא זיהתה בדיוק גבוה, ותוסיפו לזה שהמחשבים של גוגל נחשפו לפִּי כמה וכמה יותר תמונות מאשר האדם הממוצע, אז לכאורה הם היו אמורים להצליח במשימה שכל ילד או ילדה יכולים להצליח בה.

אבל בלי שהם שמו לב, נראה שהמכונה למדה שכל פרצוף דמוי-אנוש עם גוון שחור הוא גורילה. מבחן התוצאה שלהם היה מרשים, אבל לא מקיף מספיק. הם ניסו לרבע את המעגל, ובתוך הפינות של הריבוע שהם לא נגעו בהם צמחו להם תובנות אחרות בתוך המכונה, תובנות שהובילו לסערה המדוברת. וכאן שוב אנחנו רואים את אחת מנקודות התורפה של הגישה שדיברנו עליה היום: אנחנו שולטים באופן נרחב על סוג הדאטה שאנחנו מאכילים את המכונה, אבל השליטה שלנו על המסקנות שהיא מסיקה מן הדאטה עדיין מוגבלים מאד. ולכן, עם ההגבלות הללו מגיעים גם התנהגויות לא צפויות של המכשירים הללו שבנינו. האתגרים הללו חופפים לתחום חשוב של AI Safety, שעוד נדבר עליו בהמשך, אבל עוד חזון למועד.

ולסיום הדוגמה הזו שווה להוסיף, שבעוד ב-2017 אולי חשבו כולם שהם יתקנו את הבעיה עם הפרצופים מהר והיא לא תחזור, מסתבר שזו בעיה קשה לפתרון. הבעיה הזו צצה לה שוב ושוב לאורך השנים, לא רק בגוגל, ונראה לי שראיתי שלפחות נכון ל-2023 החברות הגדולות עדיין מסרבות לתייג באופן אוטומטי יצורים שקרובים לבני אדם, כמו גורילות וקופים, מחשש שהתיוג יוביל למשהו מעליב כמו שקרה אז.

אז זהו להיום!

אז - מה מחכה לנו בפרק הבא? כל מה שאמרתי כאן הוא סוג של תיאור כללי מבחוץ, נפנוף ידיים שכזה. זה יכול להישמע ממש קל פתאום. מראים למכונה דוגמאות, מתקנים או מאשררים את הניחושים שלה, היא משפרת לכיוון היעד וסיימנו! אבל כמובן שזה דבר ממש מורכב, שלא סתם לקח לקהילת מדעי המחשב עשרות שנים להגיע אליו. בפרק הבא אני רוצה לפתוח קצת את התהליך הזה, להרים את מכסה המנוע ולדבר קצת על מה שקורה שם. וכמו תמיד, על הדרך נבין גם את החוזקות במה שיש לנו, וגם את החולשות שימשיכו להציק. שוב, כמו היום - ממעוף הציפור, עם דגש על המוטיבים המנחים של מה שמוטמע במערכות הללו.

אני מקווה שנהנתם, ואם מצאתם טעות במה שאמרתי כאן - תמיד שמח לשמוע. גם אם נהניתם אני אשמח לשמוע! אבל בינתיים, שיהיה שבוע טוב, שבת שלום ועד הפרק הבא… להתראות… ביי!!