שלום כולם, וברוכים הבאים לאלישע והזוויות. היום ה-27 לינואר 2026, ט’ בשבט תשפ”ו, ואנחנו בשלב בעונה שלנו על בינה מלאכותית שבה אנחנו בוחנים את ההשפעות שלה על החברה, בהווה ובעתיד. היום יש לנו פרק ארוך מאד מהרגיל - מה לעשות, יש הרבה זוויות שקשורות אחת לשנייה ושחשוב לי שניגע בהן. ובכל זאת, הפרק הזה הוא מתחלק לשני חלקים פחות או יותר שווים באורכם, שיש ביניהם קשר אבל אפשר גם להאזין להם \ לקרוא אותם בנפרד. אז לאלו מכם שמתזמנים את ההאזנה \ קריא לאורך הרגיל, שתדעו שאני אסמן לכם באופן ברור כשנגיע לאמצע, כדי שתוכלו לעצור בידיעה שהזרימה הטבעית של הדברים לא תקטע יותר מדי.

[שימו לב! כיוון שהפרק ארוך, יכול להיות שהקטע שמופיע במייל לא יכלול את כולו - עדיף שתלחצו על הלינק לפרק לעיל ותדפיסו מהאתר]

בנוסף אני מקליט את הפרק הזה בתאריך ט’ בשבט, אז אני רוצה להקדיש את הפרק הזה לזכרו של חברי קובי קראוס ז”ל שזה היה יום ההולדת שלו. אני גם חושב שהוא היה נהנה מהפרק הזה, ובכלל מהעונה. יהי זכרו ברוך.

רגע לפני שמתחילים - מזכיר לכולם שיש אתר לפודקאסט, יש ערוץ טלגרם ומייל - מוזמנים ליצור קשר. ובנוסף, אם מישהו מחפש הרצאה בנושא של העונה הנוכחית, או בנושאים יותר טכניים הקשורים ל-AI - מוזמן לפנות אלי בפרטי, במייל הקבוע. כל הלינקים הרלוונטים בתיאור הפרק, כרגיל. אז יאללה - מתחילים.

חלק א’: חזונות גדולים, ומה שעומד מאחוריהם

לפני שני פרקים, בפרק ה-16, דיברתי קצת על האווירה המנשבת בדבריו של דניאל שרייבר, מנכ”ל למונייד, בהרצאה שלו על השתלטות ה-AI על עולם העבודה. האווירה הזו היתה אווירה של ימות המשיח, דואליזם של דיסטופיה אוטופיסטית או אוטופיה דיסטופית שבה לא נצטרך לעבוד כי ה-AI יעשה הכל במקומנו וייתר את המעורבות שלנו. בכך, בעצם, אפשר לומר שסגרנו מעגל עם הפרק הראשון של העונה. כפי שאתם אולי זוכרים, פתחתי את העונה עם ראיון מ-2017 שבו ראיין קלאוס שוואב, ראש הפורום הכלכלי העולמי, את סרגיי ברין, אחד משני המייסדים של גוגל. באותה השיחה עלתה השאלה - איך יראה עתיד עם AI עוצמתי? תזכרו שכל זה כש-GPT נמצא הרחק בעתיד, אי שם ב-2022. והנה הקטע בשיחה שלהם שעורר אז סערה בחוגים מסויימים - אני מתרגם כאן לעברית, וניסיתי לדייק קצת יותר מהתרגום שלי בפרק הראשון. אז - רק תזכורת למי שהספיק לשכוח:

שוואב: חשש מסויים ששמעתי מהרבה אנשים הוא שהנה, יש לטכנולוגיה שלנו כיום יכולות אנאליטיות, מכאן נתחיל ללכת ליכולות תחזיתיות, כמו שיש לחברה שלך, גוגל, אבל בהמשך אולי אפשר להיכנס למצב של התווית מדיניות, כלומר אולי לא צריך בחירות דמוקרטיות כי אפשר מראש לחזות ולדעת מה תהיה התוצאה. האם אתה מסוגל לדמיין מציאות שכזו?

ברין: האמת שאז תצטרך לשאול, למה צריך בכלל נציגים נבחרים, שהרי אפשר כבר להחליט את כל ההחלטות שצריך באופן אוטומטי. אתה נכנס כאן לשאלות עמוקות ביותר. אפשר גם לשאול “מה בכלל נרצה בעתיד?” הרי יש לנו היום ערכים ושאיפות שהן כנראה שונות ביותר ממה שהיה לפני המהפכה התעשייתית ולפני כן המהפכה החקלאית, ואולי נמשיך להתפתח. הרי כולנו כאן משתתפים בכלכלה העולמית, אבל חלק מאיתנו בוחרים להיות נזירים בודהיסטים ולהתמקד בהשגת הארה רוחנית – אז אנשים מתפתחים באופנים מיוחדים ומחפשים משמעות באופן שונה בסיטואציות שונות, כך שאולי בעוד מאה שנה הדברים ייראו לנו אחרת לגמרי באופן שלגמרי אי אפשר לדמיין היום או לתרגם למושגים שלנו כיום.

שימו לב שוב לאווירה המנשבת כאן בשיח הזה. “מה בכלל נרצה בעתיד” שואל סרגיי ברין, ומרמז שאולי - אולי לא נרצה דבר. זה לא סתם שהוא בוחר את האפשרות ש”חלק מאיתנו בוחרים להיות נזירים בודהיסטים” שמתמקדים בהארה רוחנית. עבורו, וכנראה גם עבור קלאוס שוואב, השיפור שה-AI יביא בתנאי הקיום האנושי ישנו את טבע האדם. שימו גם לב לכך שהדברים באים כתשובה לשאלה - “למה שנצטרך בחירות דמוקרטיות.” הרי ה-AI יוכל לנהל עבורנו הכל, כולל להריץ סימולציה של בחירות כדי לדעת מה נבחר ואז לייתר את הבחירות. ואם כי זה לא מוצדק לייחס לשרייבר דעות של אנשים אחרים, אנחנו כן יכולים לשים לב לתבנית שבה חושבים אנשים מסויימים: הרעיון שה-AI ישנה משהו יסודי בקיום האנושי, ויביא אותנו למקום חדש ושונה עד לבלי היכר. על העמדה הזו אני רוצה שניתן את הדעת עכשיו.

האם באמת נוכל לייתר את הפוליטיקה בעזרת AI? תנו לי להציע שכדי להאמין במשהו שכזה באמת ובתמים, לא מספיק שנחשוב ש-AI הוא כלי חזק שמסוגל לשדרג את היכולות שלנו לעכל ולמנף דאטה. צריך גם לאחוז בתפיסה מסויימת ביחס לטבע האדם ופעילותו בעולם. צריך להאמין שהתרומה העיקרית שהאנושות מביאה לצמתי קבלת החלטות זו היכולת לעבד מידע באופן אינטלגנטי ואפקטיבי. ברגע שמאמינים בכך, מצד אחד, ובתבוניות של ה-AI מצד השני, קל לעשות את הצעד הבא המתבקש ולדמיין עולם שבו אנחנו מעבירים את שרביט ניהול החברה ל-AI שיש לו אינטלגנציית-על.

כדי להדגים את העניין, שווה שנבחן איך המהפכה של הבינה המלאכותית נתפסת מנקודת מבט של אידיאולוגיה ידועה אחרת, הרי היא האידיאולוגיה הסוציאליסטית, בניגוד לזו הקפיטליסטית. זה יהיה קצת בנפנופי ידיים והכללות, ובעיקר נועד להדגים את הרעיון ולתת לו מרחב נשימה. אז, אני עומד מאחורי הדברים שאומר כאן, אבל תזכרו שהשיח הוא בקווים כלליים ועל קצה המזלג בלבד, ונועד לעורר את החשיבה בנושא.

על פי התפיסה הסוציאליסטית, חלק גדול - ואולי במובן מסויים כל - הבעיות של המצב האנושי מגיעות ממקום של חוסר חומרי ועיוותים חברתיים. כיוון שכך, המפתח לגאולת האדם והחברה נעוץ בעיצוב נכון של החברה, של היחסים שבין הפרט לשאר החברה, ובין האדם לנכסיו. בגרסאות אידיאליסטיות מסויימות של הסוציאליזם, בסוף התהליך הזה לא יהיו מלחמות ומריבות, והאדם יגיע באמת לרובד קיום אחר ממה שאנו מכירים כיום, אוטופיה של ממש. אלא שכדי לפתור את המצב החומרי והחברתי הזה אנחנו זקוקים לריכוז מאמצים כחברה בכיוון אחד, לשים בצד את האגו ולפעול כיחידה אחת. כאן גם מגיעה ההתנגשות עם הגישה הקפיטליסטית שהולכת בכיוון הפוך ב-180 מעלות. זו סבורה שהאדם פגום מיסודו באופן שלא ניתן לתיקון מלא, ולכן החלומות הסוציאליסטים נדונים לכישלון. במקום זה הקפיטליזם מעדיף לקבל את האגואיזם והאינדבדואליזם כנתון חקוק בסלע, ולבנות מערכות שיגרמו לחברה כולה להרוויח כשאינדיבדואל מקדם את עצמו. כמובן שמבחינת הסוציאליזם, הקפיטליזם גורם לבזבוז אנרגיות משווע ומאבקים בין-מעמדיים נצחיים שמעכבים את הגאולה. כיוון שכך, בכל מימוש של הרעיון הסוציליסטי עד היום יש דרישה לריכוז משאבים וכח בידי “החברה”, כשאת קולה הממשי של החברה מייצגים גופים כמו הממשלה, האו”ם, ועוד ארגונים לאומיים ובינלאומיים. וכמובן, מתבקש שאותם גופים ינווטו את החברה בעזרת אוסף אנשים חכמים ומוכשרים, כאלו שיוכלו להחליט באופן הטוב ביותר איך להגיע ליעד.

יש כאן ראייה אופטימית ביותר, אין ספק. מעבר לאופטימיות ביכולת של האנושות לעבור פאזה, אנחנו מוצאים גם אופטימיות ביחס לכוחה של האינטלגנציה האנושית: האמונה באותו אוסף של מומחים שיוכלו למצוא את המסלול המושלם אל עבר האוטופיה. אבל נסו לדמיין איך ולדימיר לנין בתחילת המאה ה-20, או אפילו מרקס ואנגלס שפיתחו את התיאוריה הסוציאליסטית במאה ה-19, היו ניגשים לבניית החזון שלהם אילו היו בידיהם הכלים הטכנולוגיים שיש בידינו היום. זה הרי מתבקש שהם היו מתפתים לומר לנו דברים באותה הרוח של ברין ושוואב: בואו ניתן ל-AI את כל הכח להחליט החלטות בעולם על ניהול משאבים, וכך נגיע לאוטופיה. יש כאן גם שדרוג אמיתי מעבר למה שיכולנו לקבל ממועצות מומחים של הפוליטביורו של ברית המועצות, כן? הפוליטביורו היה מורכב מבני אדם, כאלו עם דחפים ורצונות אנושיים ופגומים, וגם עם תשומת לב ואינטלגנציה מוגבלים. אפשר היה לשחד את חבריו, והם גם יכלו לשכוח דברים או לפספס מידע חשוב. כל הבעיות הללו לא יהיו רלוונטים עבור AI שמנהל את העניינים!

הראייה הזו ממש מתבקשת. כן, הקפיטליזם יצר עבורנו את ה-AI, אבל עכשיו הוא עצמו יביא לנו בהפוך-על-הפוך את המימוש המלא של החזון הסוציאליסטי. ה-AI זו יישות נייטרלית, רציונלית, שתמיד פועלת מכח דאטה אמיתי, וללא שהיא מפספסת אפילו בדל דאטה אחד. היישות הזו גם מסוגלת, ברמה הטכנית הפשוטה, לנהל את המשאבים ברמה מדוייקת, ברזולוציה של שברירי אגורה ומילימטר בודד, היא לעולם לא תצטרך לישון או תהיה עייפה מלילה של שתיית וודקה. היא גם תוכל לאסוף דאטה בכמויות שדורות עברו לא יכלו לדמיין. נראה שהגביע הקדוש בהישג ידינו - גם אינטלגנציה אדירה וגם ריכוזיות של שליטה, התשתית שאוטופיה סוציאליסטית תמיד שאפה אליה. מערכת שתוכל להנדס במדוייק את חברת המופת שרצינו, שבה כל אחד עובד כפי יכולתו, וכל אחד מקבל לפי צרכיו.

שלום לך, אח גדול

מה דעתכם? מתלהבים? או שמא מתגנב לליבכם חשש קטן, קטן ממש, שמשהו כאן לא מריח טוב?

למי שהדברים הללו מזכירים מדינות משטרה, אתם לא רחוקים מהיעד. בסין, אני משער שכולכם יודעים, יש מעקב מתמיד אחרי האזרחים, והכנסת AI למערכת שכזו יכולה למנוע מהאזרחים להימלט ממעקב מדינתי 24-7. הספר “1984” של ג’ורג’ אורוול, ספר מסוף שנות ה-40 של המאה הקודמת שתיאר איך יראה עתיד תחת שליטה קומוניסטית (שממנו מגיע, למי שלא יודע, שם התכנית “האח הגדול”, על שם המצלמות שדרכן תמיד מישהו צפה בך). הספר הזה נראה קרוב יותר מתמיד להתממשות כשטכנולוגיה שכזו זמינה לשלטון. ולצערי, נראה שגם בעולם המערבי אנחנו שומעים אנשים בכירים בתעשיית ההייטק שלא הטמיעו את הלקחים מהספר הזה, או שמעולם לא קראו אותו. ואולי הם חושבים שהם חסינים מהבעיות שהספר הזה ניסה להדגיש, שבמידה מסויימת יוהרה שכזו היא מצב גרוע יותר. תקשיבו לדוגמה לדברים שאמר לארי אליסון, מנכ”ל אוראקל, אחת מחברות ההייטק הגדולות בעולם, בספטמבר 2024 בכנס שבו דיבר על החזון שלו לעתיד. אני קצת חתכתי חלקים באמצע כדי לקצר, אבל הלינק כרגיל מופיע בתיאור הפרק ואתם מוזמנים ללכת ולראות בעצמכם. וכך הוא אמר:

“עיצבנו מחדש לחלוטין מצלמות הגוף של המשטרה. מצלמות הגוף שלנו עולות 70 דולר, מצלמת גוף רגילה עולה, אני לא יודע, 7,000 דולר. מצלמות הגוף שלנו הן פשוט עדשות, שתי עדשות המחוברות לאפוד המחובר לסמארטפון שאתה לובש. אנחנו לוקחים את הווידאו של השוטר. והמצלמה תמיד דולקת. אתה לא מפעיל ומכבה אותה. [שוטר יכול לומר], ‘אורקל, אני צריך שתי דקות כדי ללכת לשירותים’, ואנחנו נכבה את זה. האמת היא שאנחנו לא באמת מכבים את זה. מה שאנחנו עושים זה, אנחנו מקליטים את זה, כך שאף אחד לא יכול לראות את זה, כך שאף אחד לא יכול לגשת להקלטה הזאת בלי צו בית משפט. כך אתה מקבל את הפרטיות שביקשת, אבל בהינתן צו בית משפט, אם שופט יורה לחשוף את מה שנקרא הפסקת שירותים... אז אנחנו משדרים את הוידאו חזרה למוקד המשטרתי, וה-AI כל הזמן מנטר את הוידאו… אז השוטרים תמיד יתנהגו בצורה הטובה ביותר, כי אנחנו כל הזמן צופים ומקליטים את כל מה שקורה. אזרחים יתנהגו בצורה הטובה ביותר, כי אנחנו כל הזמן מקליטים ומדווחים על כל מה שקורה. לא יהיה ניתן לערער על הדיווח הממוחשב. גם ברכבים מותקנות מצלמות…”

כן כן, ממש “האח הגדול”, אבל כזה שמרוח עליו חיוך של אחד ממנהיגי ההייטק המערביים. ובכלל חשוב שתדעו, שבכל מני מקומות בעולם המערבי יש גורמים ממשלתיים שדוחפים יותר ויותר למעבר לאמצעי זיהוי דיגטליים והטמעה של AI בתוכם, כמו לדוגמה באנגליה. בדיוק לאחרונה, בראיון לטוני בלייר באנגליה, אמרה שרת הפנים שבאנה מחמוד את הדברים הבאים לגביי הטמעה גוברת של בינה מלאכותית במדינה:

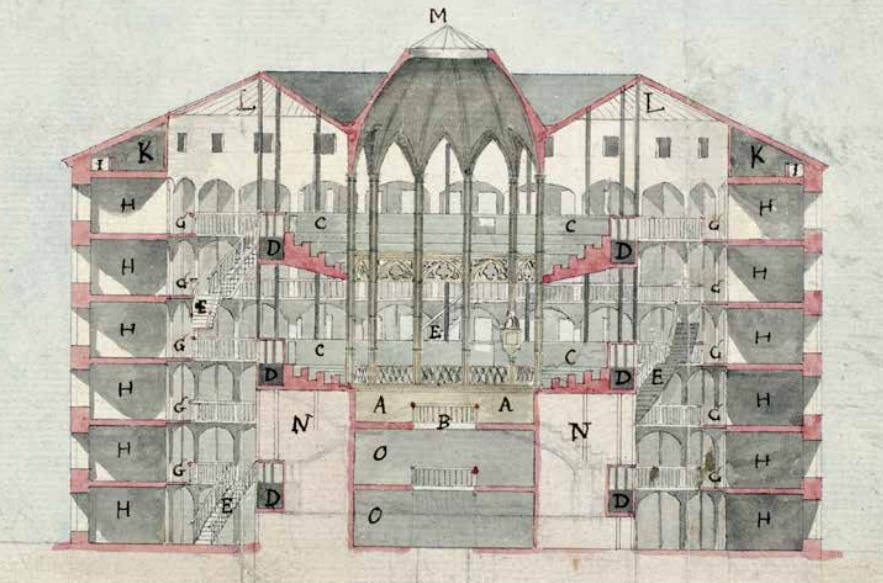

“כשעבדתי במערכת המשפט, החזון הסופי שלי עבור החלק הזה של מערכת המשפט הפלילית היה להשיג, באמצעות בינה מלאכותית וטכנולוגיה, את מה שג’רמי בנת’אם ניסה לעשות עם הפנאופטיקון שלו. וזה שעיני המדינה יוכלו להיות עליך בכל עת.”

ה”פנאופטיקון“ המדובר הוא מודל של מבנה אדריכלי שתוכנן על ידי הפילוסוף ג’רמי בנת’אם במאה ה-18, המאפשר לשומר יחיד בבית הסוהר להשגיח על כל האסירים בבית הסוהר מאתר מרכזי, מבלי שהם ידעו אם הם נמצאים תחת פיקוח ברגע נתון. אני מצרף כאן לינק למעוניינים, אבל דמיינו בית כלא בצורה של מעגל, עם מגדל שמירה במרכזו שיכול לראות כל פינה בבית הכלא, כולל לתוך החדרים. הדברים של מחמוד נאמרו, למיטב הבנתי, בהקשר של מעקב אחרי פושעים לשעבר או אנשים שאיזה AI חוזה שהם יהיו פושעים בעתיד, אבל לא קשה לראות איך קיומה של מערכת שכזו באופן טבעי תוביל בהמשך למעקב אחרי האזרחים כולם, ומדינה דמוית סין ואף גרוע מכך. אנחנו נצטרך כנראה להמשיך ולעקוב ולראות כיצד המאבקים הפוליטיים על העניין, במדינות שבהם החופש של האינדבדואל הוא אבן יסוד תרבותית, יסתיימו בשנים הקרובות.

אשליית האובייקטיביות

הגישה הזו מטרידה ביותר, לפחות בעיניי, וכמות הסכנות שטמונות בה ארוכה מכדי שנוכל לסקור כאן את כולן. אחת הסכנות הגדולות היא שמציגים כאן מצג שווא לפיו האזרח יפגוש תמיד את ה-AI האינטלגנט, האובייקטיבי וההוגן, חסר ההטיות, הגזענות וכן הלאה. את העובדה שה-AI מפספס דברים גם כן וטועה בגדול בנקודות קריטיות סקרנו בפרק ה-16 בהרחבה, וכבר שם אנחנו אמורים לעצור את הרכבת לפני שהיא הולכת רחוק מדי. אבל עזבו, בואו נדמיין מערכת AI שאין לה את הטעויות הללו. השיחה כאן מתנהלת כאילו שלא יהיו מאחורי מצלמות האבטחה הללו שרואות הכל גם בני אדם, כאלו שיחליטו את מי להעניש וכמה, איך לכייל את המערכות האוטומטיות, איך לאמן את ה-AI או להטות אותו. אפילו לארי אליסון דיבר על השופט האנושי שיחליט מתי לחדור מבעד למעטה הפרטיות של הזמן של השוטר בשירותים. וכיוון שבסוף יהיו בני אדם בסיפור, אין ספק שיקרה מה שקרה תמיד בעבר, שהאנשים שקרובים לצלחת - נניח, ראש מדור המיחשוב שאחראי על הוצאה לפועל של העונשים על העבירות שהמצלמות תופסות - האדם הזה יקבל הנחות על עבירות שביצע, שלא לדבר על זה שבני משפחתו יקבלו טיפול מיוחד, ואולי גם אויביו הפוליטיים. פעם נהגו להסתתר מאחורי טייטלים וארשת של “מוסד”, כזה שבוודאי הוא אובייקטיבי. היום מנסים לעשות זאת דרך המסך של ה-AI שאותו האדם יפגוש, ומסתירים את הגורם האנושי שיהיה נתון לתמריצים עוצמתיים ביותר להישחת. כאן אני תמיד נזכר בדבריו של ג’ורדן פיטרסון, שאמר את הדברים הבאים על אלו שמצהירים ש”סוציאליזם אמיתי מעולם לא נוסה”:

“ואז כשהמרקסיסטים אומרים, ‘טוב, זה לא היה מרקסיזם אמיתי’, המשמעות האמיתית של הדברים - ואני חשבתי על הדברים הללו רבות, זו אחת ההצהרות המתנשאות ביותר שמישהו יכול היה לומר - ‘אם זה היה אני במקום סטאלין, הייתי כבר דואג להביא אותנו לאוטופיה במקום רצח העם שהוא הוביל, בגלל שאני מבין את הדוקטרינה המרקסיסטית וכל כולי רק טוב צרוף’

ובכן, תחשוב שוב, קרן אור טהורה שכמותך, אתה לא מבין אותה. אתה לא מבין אותה, ואינך כה טוב. ואם הכח היה בידך, בהינתן שהיתה לך היכולת - שאין לך, יש לציין - לא היית מצליח יותר. וגם אם היית, היה מישהו אחר שממתין לרגע הראשון שהיית מנסה לעשות טוב, שהיה יורה בך בגב ברגע שהיית מנסה לעשות משהו טוב. זה בדיוק מה שקרה לכל המהפכנים המקוריים שהובילו את המהפכה הקומוניסטית - סטאלין אסף את כולם והוציא אותם להורג, יחד עם המשפחה שלהם ועוד מיליונים. אז גם אם אתה במקרה ממש אותו הכלי לטוב הצרוף שאתה טוען שהינך, הסיכוי שהיית מסוגל לממש את הטוב הזה שלך ביחס לאנשים שמחזיקים באותה האידיאולוגיה, שואף לאפס.

הכח משחית, וריכוז כח כמו שמדומיין כאן, ישחית כל אדם שיבוא איתו במגע.

אבל מעבר לעובדה המעשית הזו, נקודה חשובה שעלתה לנו במהלך העונה חייבת להופיע גם כאן, והרי זו המרכזיות של פונקציית המטרה, וחוסר היכולת של אינטלגנציה בלבד, וה-AI בפרט, להכריע בין פונקציות מטרה. אליסון מציג את הדברים כאילו AI הינו כלי רציונלי וחסר פניות, אבל בסוף כל מערכת מקודדת בתוכה הטיות, שכן פונקציות מטרה שונות מתעדפות דברים אחרים. נניח שה-AI הקליט אירוע באזור עם תאורה מוגבלת ויש סיכוי של 43% שבוצעה עבירה. האם לדווח עליה, או להחליק? ומה עם 78%? ומה עם 2%? קביעת הסף תקבע עד כמה אנשים יחושו את נחת זרועה של המשטרה, כמה תקציב המשטרה תצטרך כדי לתפקד, האם היחס לאנשים יהיה שהם חפים מפשע עד שיוכח אחרת או להיפך, וכן הלאה.

כאן גם מסתתר לו עוד רובד של החזון הזה שבו ה-AI מחליט דברים עבור כולנו, עולם שבו לא צריך בחירות דמוקרטיות. החזון הזה בעצם משקף תפיסה לפיה מה ש”טוב” ומה ש”רע” אלו דברים ברורים, ולכן אין שאלות גדולות, והכל מתכנס לשאלת היישום היעיל, איסוף הידע באופן מדוייק ועיבוד שלו באופן מדוייק. אבל הרי ברור שבדיוק על שאלת הטוב והרע יש ויכוחים גדולים ביותר, מאז ימי קדם. העולם האוטופי שאני מדמיין הוא כנראה עולם אוטופי אחר מאשר אימאם מצרי ידמיין, שהוא שונה ממה שאתאיסט נורבגי או כומר אפריקאי ידמיין. ולכן ברור שגם בעולם עתידי שמנוהל באופן חלקי על ידי AI אנחנו נצטרך בחירות דמוקרטיות, כי בעצם דרכן אנחנו מגדירים ומעדכנים את פונקציית המטרה שלנו כחברה, שכפי שאמרנו אין ל-AI כל דרך לקבוע מה היא צריכה להיות. בואו נגיד - ספינה מודרנית ש-AI יכול לנווט אותה אולי תייתר את הידע על איך להפעיל את ההגה של האוניה, וזאת בניגוד להכשרה של קפטן ספינה במאה ה-16, אבל השאלה לאיזה כיוון לשוט לא התייתרה רק בגלל שעכשיו הטכנולוגיה מפעילה את המדחפים השונים.

איפה מתקבלות ההכרעות המוסריות

מה שתיארתי כאן, הנסיון לטאטא מתחת לשטיח (במכוון או בלי משים) את ההכרעות שה-AI יכריע בנושאים נתונים במחלוקת, אינו בעייתי ומסוכן רק כשמגיעים לרמה של ניהול המדינה וביטול הבחירות. הבעיה הזו בעצם מתרחשת בכל פעם שאנחנו מחליטים להשתמש ב-AI, וככל שאנחנו מרחיבים את השימוש בו, כך אנחנו בעצם מאצילים אליו החלטות מוסריות לא טריוויאליות, כאלו שישפיעו על החברה באופן רחב.

קחו לדוגמה מכוניות אוטונומיות. סביר שבקוד של הרכבים הללו יכתב שאסור להם לעבור על החוק, שהם חייבים לציית לחוקי התנועה - נכון? זה מתבקש. אבל החוק איננו חזות הכל. יש מצבים שבהם שיקול הדעת האישי צריך לגבור על החוק היבש. אם אתם צריכים להגיע מהר לבית החולים כי בת הזוג שלכם עומדת ללדת, אתם תרצו לנהוג בשוליים כדי לעקוף את הפקק באיילון. ומה אם ה-AI שנוהג ומנווט במקומכם יגיד “סליחה, זה אסור, זה בניגוד לחוק”?

כך גם בנושא תאונות הדרכים - מה ההוראות שניתנות למחשב כדי לצמצם נפגעים, על מי צריך להגן ועל חשבון מי? ילד קפץ לתוך הכביש - האם עדיף להגן על הנהג או על הילד? לסטות ימינה ולפגוע בסבתא בת 90 או שמאלה אל עבר עגלת התינוק שאי אפשר לראות אם יש תינוק בתוכה? מה אם ברכב יש 4 נוסעים ואני עומד לדרוס 4 ילדים, מי צריך לשלם את מחיר התאונה?

כשבני אדם נוהגים ברכבים, פעמים רבות ההחלטה היא עניין של שברירי שנייה וריפלקסים בלתי-מותנים. אפילו המילה “החלטה” זו מילה חזקה מדי פעמים רבות, כי הכל קורה כל כך מהר שאין דרך לצפות מהאדם לשלוט בדיוק מה שקורה. אבל במקרה של רכבים אוטונומיים, כשהרכב מסוגל להגיב באופן כמעט-מיידי למידע שזורם אליו מהחיישנים שלו, יושב לו צוות מתכנתים ואנשי מוצר בחברת טסלה וקובע איך הדברים יתגלגלו בעוד שנה כשהמוצר שלהם יעלה על הכביש. הם דנים וקובעים את מדיניות החברה ביחס לחיי אדם.

מה שחשוב כאן איננו שההחלטות הללו נעשות שם בחדרי חדרים, ואני לא קובע שמדובר בהחלטות שגויות. מה שחשוב הוא שגם כאן, כמו במקרה של ניהול המדינה, האירוע שבו אנחנו מאבדים שליטה ואחריות על ההכרעות המוסריות נוטה לקרות ללא שאנחנו מודעים אליו בכלל. אומרים לנו - “רכב אוטונומי הוא בטיחותי יותר ומצמצם תאונות”, ובכך מחליקים את העובדה שנפל פה דבר. הדברים אפשריים, שוב, רק בגלל שה-AI לובש ארשת של אובייקטיביות טכנית, בעוד שבעצם ההחלטות שהוא עושה נוגעות לשאלות מוסריות הרות גורל.

העברת האחריות המוסרית על התאונות של הרכב האוטונומי שלנו לחברת טכנולוגיה נוצצת מובילה גם היא למקומות ששווה לתת עליהם את הדעת, ונזכיר כאן רק אחד מהם: שככל שנאפשר ל-AI לקבוע בשבילנו את מי לדרוס ואת מי להציל, פסיכולוגית אנחנו נתחיל לתפוס את ההתנהגות של הרכבים בשטח כסוג של חוק טבע חדש שאין לנו מה לעשות לגביו. “הילדה קפצה לכביש, והרכב עשה מה שהרכב תמיד עושה”, אנחנו נגיד, כאילו ביצועי הרכב הם כמו כח הכבידה שאין לנו שליטה עליו. האירוע שבו שחררנו את ההחלטות מידינו הוא גם אירוע שמרגיל אותנו שהנושא הזה לא באחריותנו, ובכך גם נמנעים תהליכים טבעיים של למידה ועדכון התנהגות. מכונות, כפי שכבר אמרנו, עושות רק את מה שאמרו להם לעשות. בני אדם, לעומת זאת, יכולים לשקול מחדש את סט הערכים שלהם, ולשנות את פונקציות המטרה שהם מנסים להצטיין בהם. תהליך הבירור, השקילה והעדכון הזה הזה יפסיק לקרות, או יתמעט מאד, בכל מקום שבו נחליט לבצע האצלת סמכויות מוסריות מהציבור למוסד ריכוזי, בין אם זה AI שמנטר ומנווט את המאמצים המשטרתיים, ובין אם זו בינה מלאכותית שרצה במליוני רכבים אוטונומיים ברחבי העולם, אבל כולה מאומנת במשרדי טסלה.

לסיכום החלק הראשון, נאמר כך: כל הגישה של שוואב וברין, וכנראה גם של אליסון ודומיו, מבוססת על התפיסה שה-AI הוא רציונלי ומושלם, המציאות יכולה גם היא להיות מושלמת, וכל מה שעומד ביננו לבין אותה שלמות זו המוכנות שלנו לתת ל-AI לנווט את החברה עבורנו, כשהמחיר שנשלם הוא רק הויתור על החירות שלנו לבחור דברים עצמאית. ובאמת, אם ה-AI יכול לבחור דברים עבורנו באופן הרבה יותר מדוייק וטוב מאשר אנחנו יכולנו לעשות, האם לא נראה בכך מחיר מציאה, מבצע שכדאי לקפוץ עליו מהר לפני שיגמר?

אלא שגם אם ה-AI היה מושלם, המחיר הזה הוא גבוה מדי. לא רק שה-AI איננו יכול לקבוע מהי פונקציית המטרה של החיים שלנו, הדרך היחידה שבה אנחנו יכולים לצמוח ולגדול ולגלות מהי המטרה הזו היא דרך תהליכים של ניסוי, טעייה, התאוששות ולמידה. לטעות זו זכות, ורובנו יתעקש על הזכות הזו וילחם עליה עד חרמה.

הדברים שראינו כאן מזכירים לי ציטוט מתוך ספרו של אלדוס האקסלי, הספר “עולם חדש מופלא”. (וכן, למי שהדברים ישמעו מוכרים, אני בעצם חוזר כאן על מה שאמרתי בסוף הפרק החמישי של העונה הראשונה). אם העולם של “1984” מדבר על דיסטופיה קומוניסטית, הרי שבעולם העתידי הזה של הספר “עולם חדש מופלא”, אנשים נולדים באופן סטרילי, דרך פס-ייצור גנטי בבית חרושת, והגנטיקה שלהם מהונדסת ככה שכל אחד גדל לתפקיד ספציפי בחברה, ומוצב מראש בתפקיד הזה על ידי המערכת החברתית. גיבור הסיפור הוא ג’ון, איש צעיר שנולד באופן ה”ברברי”, כלומר דרך רחם של אישה, שמתגלגל חזרה לחברה הזו, שם רואים בו “פרא”. בתחילה הוא נדהם מהתחכום המדעי שלה וקורא לה “עולם חדש מופלא”, אבל בהמשך הוא מתחיל להבין שמרוב שהחברה הזו מתוכננת וסטרילית, היא לא מאפשרת ליחיד להביע את עצמו, למצוא את עצמו, לחדש משהו. בויכוח שג’ון הפרא מנהל עם אחד ממנהיגי החברה הזו על טיב החברה, אומר לו המנהיג:

“אבל זהו המחיר שאנו צריכים לשלם עבור יציבות. אנו צריכים לבחור בין שמחה לבין מה שאנשים נהגו לקרוא לו אומנות גבוהה, ואנחנו הקרבנו את האומנות”

ובמקביל, יש שם גם דיאלוג נוסף שאני מצטט כאן באופן חלקי:

“אין בעיה”, אמר הפרא, “אני תובע את זכותי להיות עצוב”

“שלא לומר להזדקן ולהיות מכוער ואימפוטנט” אמר המנהל, “את הזכות לחלות בסרטן, את הזכות שלא לקבל מספיק אוכל, את הזכות לסבול. את הזכות לחיות במצב תמידי של דאגה מן המחר. את הזכות לחלות בטיפוס, ואת הזכות לעבור ייסורים גדולים ביותר”

שתיקה ארוכה השתררה בחדר.

“כן”, אמר הפרא, “אני תובע לעצמי את כולן”

אז לסיום החלק הראשון, תנו לי להשאיר אתכם עם השאלה: מה אתם הייתם בוחרים?

חלק ב’: האדם כראש הצוות

אוקיי, אז המקום שאליו הגענו הוא שה-AI הוא כלי עוצמתי, ועלינו האחריות להדריך אותו ולכוון אותו. דימוי שמסתובב המון ברשת הוא שברגע שיש לנו גישה ל-AI, אנחנו בעצם מנהלים את המקבילה הסיליקונית של צוות מקצוענים בכל תחום בעולם, כזה שיעשה את כל מה שנבקש מהם. אולי נדמיין דווקא חייזרים שנחתו ומוכנים לעבוד בחינם, כלשונו של שרייבר. אם אנחנו זורמים עם הדימוי הזה, אז בארגונים וחברות יש שם לתפקיד שלנו במערך הזה, והטייטל הוא - ראש צוות. בהכנה לפרק הזה ניסיתי לגשת למה שאני עומד לתאר מהמון כיוונים, כתבתי עמודים שלמים עם הגדרות משוייפות, אבל אחרי מספר לא קטן של טיוטות מצאתי את עצמי מתכנס לתיאור הזה, ראש צוות. כרגע אני משער שאתם לא מבינים מה הביג דיל בדימוי הזה, כזה שממלא בכל יום עשרות פוסטים בלינקדין, פוסטים שעצמם מעוצבים ברובם על ידי AI, או לפחות זו התחושה. ועל זה אני בונה - שככל שנתקדם ונעמיק תראו רבדים עמוקים יותר של הדימוי, ותבינו למה אימוץ שלו יכול לעזור לנו לדעת איך לגשת לאתגרים שבשימוש ב-AI. אני גם אנסה להדגים איך הוא פותר או לפחות מבהיר עבורנו את אחת התעלומות סביב החשיבות של הכשרה אנושית בעידן החדש שבו AI זמין לכולם.

אז כן, אני יודע - עשיתי כאן בילד-אפ רציני, ועכשיו אני אצטרך לפרוע את החוב. בואו ניגש לעניין. אני רוצה לשאול - מה הופך ראש צוות למוצלח בתפקיד שלו?

הדעות מגוונות, כמובן, ולרוב גם נחרצות. כל מי שעבד בחברה כשכיר, כמוני, יגיע עם רשימה של הדברים שחשובים לו או לה, על בסיס הנסיון שלו או שלה. אני משער שברשימה הזו יהיו רגישות אנושית ופוליטית, כלומר להשלכות הארגוניות של החלטות; סדר וארגון; מוטיבציה ויכולת להניע את הצוות לפעולה; יכולת הבעה בעל פה וכתב; ועוד דברים. וכל הדברים הללו - אולי מלבד הפריט הראשון ברשימה, הרגישות האנושית - חשובים גם כשאנחנו עובדים עם AI. סדר וארגון, הבעה בכתב - אלו דברים שעוזרים בהרבה תחומים, וכשמדובר בבינה מלאכותית מבוססת פרומפטים, הדברים רלוונטים בהחלט.

אבל לרשימה שנתתי יש עוד תכונה או יכולת שחשובה, ואני שואל את עצמי אם מישהו שם לב מה השמטתי כאן. קחו כמה שניות ותחשבו. כן, ככה, שניה, שתיים…

התכונה שאני מדבר עליה היא יכולת טכנית מעל הממוצע בתחום האחריות של הצוות.

“טוב, זה ברור” אומרים כל המאזינים עכשיו, כלומר אתם. “אף אחד לא היה חושב אחרת”. ובהחלט, אנחנו מכירים מנכ”לים של חברות הייטק שלא כתבו שורת קוד אחת בחיים, אנשים שמונחתים מלמעלה בגלל יכולות אחרות שיש להם, אבל ראש צוות בהייטק הוא תמיד - יודעים מה, בואו ניצמד כאן ללשון נקבה בשביל הגיוון - ראש צוות בהייטק זו תמיד מישהי שצמחה מלמטה, מזה שהיא לכלכה את הידיים בעבודה השחורה והיומיומית של כתיבת הקוד. רק לאחר שהיא בנתה לעצמה נסיון של כמה שנים ישקלו לקדם אותה לראשות צוות. הסיבה לכך גם ברורה: רק מתוך ההיכרות עם עולם המושגים של המוצר וכלי התוכנה, מתוך זה שהיא עבדה עד אמצע הלילה לפתור באג ומתוך ההצלחות שהיו לה בקריירה - רק מתוך אלו היא תוכל לזהות את המקומות שבהם הצוות זקוק להכוונה, שיש למישהו בצוות אזור עיוורון שצריך להאיר עליו פנס, כמו גם לפרק את המשימות לתפקידים השונים בצוות ולראות שהם לא מתנגשים.

הנסיון הזה שלה גם עוזר לה לדעת איפה לא להתערב, איפה מה שאולי נראה בעייתי הוא בעצם בסדר, וזו גם יכולת חשובה שמונעת עיכובים מיותרים. ואמנם אמרתי שהיא צריכה יכולת טכנית מעל הממוצע, אבל כמובן שככל שהיא שיכללה את הידע שלה בתחום המקצועי של אנשי הצוות, כך הצוות כולו ירוויח, שכן הם יוכלו לשתף איתה עוד דילמות, והיא תוכל לתרום מהנסיון שלה במקומות נוספים.

אני יודע שהדברים ברורים מאליהם, אבל קחו רגע, קחו שניים, ונסו לדמיין איך היה נראה היום-יום של הצוות הזה אם אותה מנהלת מבריקה היתה מגיעה לא עם רקע של כתיבת קוד, אלא עם רקע של, נניח, ניהול צוות של רואי חשבון. כל היכולות שתיארנו קודם - יכולת הבעה, רגישות אנושית, אפילו הכרת השוק וכו’ - רק בלי כל ידע טכני. חוסר המקצועיות של סיטואציה כזו היא כל כך ברורה, שאין סיכוי שאי פעם נפגוש בה. המנהלת היתה מנהלת רב-שיח של חרשים עם הצוות שלה ברמה יומיומית, ובפועל הצוות היה מחליט לבד על הכיוון של המוצר, וכל שהיה נותר לה לעשות הוא להיות חותמת גומי להחלטות המקצועיות שהם לוקחים, לתמוך בהם ברמה הפרסונלית, ולהמשיך להסתובב בארגון עם טייטל שלא משקף את התרומה שלה עד שמישהו יגלה שאפשר לפטר אותה בלי שזה יפגע במוצר.

למה אני מרחיב כל כך בעניין הזה? הנה הנקודה שאני חושב שאנחנו צריכים לשים לב אליה טוב טוב. אם מישהו ינחת במשרד ויצפה בראש הצוות שלנו במשך חודשים ארוכים, יכול להיות שהוא לא יראה אותה אף פעם מדגימה את היכולות הללו באופן פעיל. יש ראשי צוותים שמפסיקים לכתוב קוד, יש כנראה עורכי דין שמאצילים למתמחים שלהם את כל העבודה של כתיבת חוזים, ויש מנהלי בית ספר שאף פעם לא מלמדים שיעור בכיתה. אבל בו זמנית, הידע המקצועי העמוק שראש הצוות שלנו מגיעה איתו הוא קריטי לעבודה שלה, והתוצרים של הצוות שלה הם בין השאר תוצרים של אותו הידע. קל להסתכל על קצה הקרחון ולהצביע על שורות קוד ולייחס אותן למפתחים, קשה יותר לשים את האצבע על המקום שבו ההנחייה שלה השפיעה - אבל אנחנו יודעים שזו היתה השפעה משמעותית.

וחזרה ל-AI

עכשיו, לאחר שפרשנו ככה את היריעה באופן נרחב, אנחנו סוף סוף יכולים לעזוב את עולם העבודה הרגיל ולחזור לעולם ה-AI ולראות איך ההקבלה לראשות צוות עוזרת לנו לעשות סדר בכאוס שמציף הרבה דיונים בנושא.

כמעט כל יום כשאני פותח את הלינקדין או את רשת X, אני רואה פוסטים של אנשים שמזלזלים בידע שהם צברו, או שאחרים צברו. “לדעת קוד זה חסר ערך. מעולם לא כתבתי קוד, והיום אני מרים שבעה סוכנים לבנות לי אפליקציה שתהיה מוכנה לפני הקפה של הבוקר”, “ידע כבר לא חשוב, מה שחשוב הוא הדמיון והיצירתיות שלכם, ותו לא”. “אני מתכנת 20 שנה, ואני מרגיש שכל מה שלמדתי שווה כקליפת השום כי ה-AI יודע לכתוב שבוע עבודה שלי בשתי דקות”. זה די מדכא לראות פוסטים כאלו, בעיקר עבור איש תוכנה שכמוני. זה מדכא קודם כל בגלל שאתה שואל את עצמך - מה אני מפספס? האם הם צודקים ואני לא? אבל עוד יותר זה מעציב לראות אנשים שיש להם ידע חשוב ביותר, ופשוט לא יודעים להעריך אותו.

הרעיון שברגע שיש לנו AI בכיס היכולות האישיות שלנו מאבדות מערכן, מחלחלות לכל מקום, ובאופן שמוחק אבחנות חשובות. את הדוגמה העדכנית אפשר לשמוע בפודקאסט הידוע “מפלגת המחשבות”, של מיכה גודמן ואפרת שפירא רוזנברג, שבחר עבור העונה הנוכחית שלו את נושא מהפכת ה-AI, עונה שהסתיימה ממש לפני כמה ימים. אני לא אחד מהמאזינים הקבועים שלהם, ובגדול אני מעריך את מה שהם מנסים לעשות בפודקאסט - לפתוח את החשיבה סביב נושאים חברתיים גדולים הנתונים במחלוקת, בעיקר בסצינה הישראלית. לצערי הרב, מהקצת שהאזנתי לעונה שלהם התאכזבתי קשות מהגישה שלהם לנושא. דווקא בגלל שהם לא אנשים טכניים, הייתי מקווה שהם יגשו אליו ממקום יותר צנוע, קצת פחות לרכב על ההייפ, קצת לפרק מושגים כמו חשיבה ואינטלגנציה… אתם יודעים, קצת לעשות “אלישע והזוויות”! אבל הרושם שלי הוא שההייפ שטף גם אותם, ולכן אנחנו מקבלים לדוגמא בפרק 149 שלהם את הקטע הבא:

אפרת: … הרבה פעמים הייתי חושבת על זה שזה נקודת האפס של האי שוויון, איך אתה נולד… וזה האי-שוויון הבסיסי ביותר…, כי זה ברור שמי שנולד עם יותר כישורים, עם יותר שכל, עם יותר יכולות - הוא בדרך כלל יותר יצליח בחיים.

מיכה: ואז בא ה-AI והבחור עם ה-100 IQ מתחבר עכשיו לקיר ופתאום יש לו דה-פאקטו 180 IQ. החבר שלו שתמיד התנשא עליו כל החיים, עם ה-140 IQ… כשהוא מתחבר לקיר, guess what, גם לו יש 180 IQ, אז עכשיו דה-פקטו לשתיהם יש את אותם כישורים אינטלקטואליים…

כקונטרה לגישה שלהם, משל ראש הצוות ממחיש שהידע והיכולות של האדם שנמצא בממשק עם המערכת שהוא מנהל הם קריטיים. הדרך למינוף ה-AI עוברת בידע אנושי רחב יותר, ובאינטלגנציה אנושית גבוהה יותר. ונכון, אולי כשנסתכל על התוצרים נראה שכולם יצאו מפיו של AI כלשהו, אבל זה רק בזכות ההדרכה שהגיעה מן האדם. כדי לדעת מה לבקש מן ה-AI לעשות, אנחנו צריכים. לדעת. דברים. אדם לא יכול לבקש לארגן טיול רומנטי בצרפת שיסתיים במגדל אייפל אם הוא לא למד גיאוגרפיה, כי הוא לא ידע שיש מקומות כאלו.ראש ממשלה שלא מבין בכלכלה יכול לחשוב ש”תיתן לכולם מיליון דולר” זה פתרון לבעיית העוני, ולא מתכון נוראי לאינפלציה. אדם שלא בנה תוכנה מימיו, לא ידע איך לגשת לבניית מערכת, ולכן תהיה לו תקרת זכוכית שלא יוכל לפרוץ שרק אנשים בעלי נסיון יוכלו. “ידע זה כח” זו מנטרה שהופכת להיות רלוונטית יותר מתמיד בעידן ה-AI, ולא פחות מתמיד, כפי שאנשי ההייפ היו רוצים שתאמינו. הדברים כל כך ברורים, שזה קצת מצחיק שהיינו צריכים להתאמץ כל כך כדי להסביר את המובן מאליו, אבל זה כוחה של האשלייה, שהמחשב הוא תבוני.

[הערת המערכת, כלומר אני: בדיוק כשעמדתי לשתף את הפרק, ראיתי ש”מפלגת המחשבות” הוציאו פרק חדש (151, בונוס) שנועד לאזן את הפרק המדובר. עדיין לא האזנתי לו, אבל נראה שגם הם הבינו שהם צריכים לאזן את העמדה שהציגו כאן. אז - כיף שאנשים יודעים להודות בטעות! מוזמנים להתמקד כאן ברעיונות שאני מבקר, ולשים בצד את הייחוס של העמדה אליהם]

משל ראש הצוות - האמת זה לא משל, זה מודל חשיבתי - עוזר לנו להבין עוד הרבה דברים. כך לדוגמה אנחנו יכולים להבין שבעידן ה-AI, הסכנה הכי גדולה ליכולת שלנו להשתמש ב-AI באופן מושכל זה ה-AI עצמו, או לפחות שימוש מוקדם מדי בכלי הזה. אם הכוח שיש לנו ביד - היכולת שלנו להדריך את הצוות הוירטואלי שאנו בראשו - היא פונקציה של הידע, האינטלגנציה והנסיון שלנו, אז הדבר הכי גרוע שאנחנו יכולים לעשות הוא לתת לעצמנו להסתמך על AI במקומות שאנחנו רוצים לצבור את הידע והנסיון הללו. אם אנחנו לא רוצים - ואף אחד לא יכול ללמוד הכל בחיים - אז בהחלט ה-AI הוא ג’וקר שאפשר לשלוף. אבל אין אפס, ובכל מקום שבו נסתמך על AI מההתחלה, אנחנו נעמוד במקום מבחינת היכולת שלנו למנף את ה-AI בעתיד. אם ה-AI יעשה עבורי את שיעורי הבית, אני ארוויח בהווה את הציון הטוב, אבל החברים שלי לספסל הלימודים שקיבלו ציון נמוך יותר בגלל שעשו את שיעורי הבית בעצמם יהיו מתקדמים יותר מבחינת היכולות האישיות שלהם, ובכך ימצבו את עצמם במקום טוב יותר לקראת העתיד. כך היה תמיד, וכך גם יהיה כשבוחנים את הדברים בפרספקטיבה של שימוש עתידי משופר ב-AI.

מאותה הסיבה, אנחנו מבינים מדוע חשוב שגם בדברים שאנחנו כבר מקצועיים מספיק, חשוב שכל כמה זמן נשים בצד את הצוות הוירטואלי שלנו ונעשה אותם בעצמנו. ראשי צוותים בהייטק שמפסיקים לקודד לגמרי, מאבדים לאורך זמן את החוש שלהם בנוגע לתכנות, כמו גם את ההיכירות עם היכולות החדשות שהתווספו למקצוע. מנהלים שוכחים את אתגרי החינוך ולא מכירים את המאפיינים המיוחדים של התלמידים בדור החדש, וכן הלאה וכן הלאה. כיוון שאנחנו מנהלים צוות, אנחנו צריכים לעשות את כל מה שנדרש מאיתנו כדי להישאר חדים ובכשירות מלאה, כולל לבצע את המשימות בעצמנו. ממה שקצת קראתי יש גם מערכות שונות במוח שמופעלות מפעילויות שונות. כאשר אנחנו מייצרים משהו בעצמנו מופעל סט אחד של מערכות, וכשאנחנו רק בודקים תוצר של מישהו אחר מופעל סט אחר. פעילות יצירתית ישירה כל כמה זמן היא המתכון לתיחזוק החלקים במוח שבנינו בעבר, לפני שנהיינו ראשי צוותים.

עכשיו, מה שמעניין בכל מה שאמרתי עד כה הוא שאלו טיפים שהיו רלוונטים… לדור הקודם, לפני ה-AI, אבל הם מקבלים רלוונטיות עודפת דווקא מתוך קיומו של הכלי הזה. וזה בעצם ה”חידוש” הגדול שאני מנסה להעביר: שככל שה-AI יהיה עוצמתי יותר, אנחנו לא יכולים להתעצל יותר אלא להיפך, לשדרג ולתחזק את היכולות האישיות שלנו, את הידע שלנו על דברים מלבד איך להפעיל AI, כדי שהשימוש שלנו בו יהיה אפקטיבי.

העניין הזה גם מרמז על משהו שמתנגש חזיתית עם החזונות של שוואב וברין שדיברנו עליהם קודם: במקום לראות את ה-AI כמאזן גדול, כמיישר קו בין כולם, כפי שאמרו ב”מפלגת המחשבות”, ה-AI הוא זריקת סטרואידים דווקא לתהליכים קפיטליסטים. הוא יעצים את המוכשרים בסדרי גודל, ויגדיל את הפערים בין הקבוצות השונות באוכלוסיה, וכל זאת לצד הרווחים האחרים של הקפטיליזם, ייעול תהליכים, הורדת עלויות וחשיפת הזדמנויות חדשות לקהלים נרחבים. לעניין שחשוב לנו כאן, קחו שני אנשים עם אותם רמות נוחות של שימוש ב-AI, מי שיצליח יותר הוא זה עם האינטלגנציה והיכולות הגבוהות יותר, עם הנסיון והידע הרחבים יותר, שהם יוכלו לתעל לשימוש שלהם. זו גם הסיבה למה השאלה איך להבין את הטכנולוגיה הזו והאופן שבו היא משפיעה על העתיד כה חשובה - האם להתכונן כמו ש”אלישע והזוויות” מציע לכם, או דווקא כמו ש”מפלגת המחשבות” מציעות להתכונן. שאלה גדולה, שרק העתיד יחשוף מי צדק בתשובה שהוא נתן.

האם טוב שהמצאנו את הכתב?

את מה שתיארתי כאן ברמת הפרט, אנחנו יכולים וצריכים לקחת גם לרמת הכלל, לרמת החברה. אם תוצרי ה-AI גדלים ככל שהמשתמש מוכשר יותר, יודע יותר, מבין יותר - הרי שהמפתח לחברה חזקה וטובה יותר הוא מציאת השילוב המאוזן בין התאקלמות למציאות החדשה ושימור היסודות החשובים מן ההווה. באותה החברה האזרחים צריכים להשתמש ב-AI ולהתמקצע בו, להביא למצב שבכל תחום עוזרים לאנשים לראות כיצד הוא יכול להעצים את הפעילות שלהם; ומאידך, האזרחים צריכים גם לדאוג להמשיך לחזק ולבנות את עצמם, לא להתעצל ולהאציל ל-AI סמכויות במקום שהיה עדיף שינווטו אותו ביד רמה. הדברים הללו אמורים גם כלפי מערכת החינוך, תהליכי ההכשרה הפנים-ארגוניים, וכן הלאה. בעולם שכזה באמת יתכן שלאחר ההכשרה הזו, לא נראה אנשים כותבים את אותה כמות של קוד בידיים כמו בעבר, או מנסחים חוזים בעצמם, אבל פה ושם הם עדיין יעשו זאת, פה ושם הם יבצעו תיקונים במה שה-AI מייצר, ובזכות זה ההדרכה שלהם של כתיבת הקוד וניסוח חוזים תגיע ממקום של נסיון ועומק. גם בעולם שלכולם יש מחשבונים בפלאפון, כדאי שאנשים יעשו מדי פעם חישובים בעצמם, עם נייר ועט וכאלה. כנ”ל לגביי נסיעה בלי שוייז דלוק.

כמובן, אין ארוחות חינם. כל כניסה של טכנולוגיה משנה את היכולות שאנשים לומדים ומתמקצעים בה, ועל הדרך יכולות אחרות מתנוונות. טענת הניוון כתוצאה מחדשנות אנושית ואימוץ של טכנולוגיות חדשות היא עתיקת יומין, וניתן למצוא אותה לדוגמה כבר בכתביו של אפלטון. לדוגמה, באחד הדיאלוגים שלו הוא מביא ביקורת על המצאת הכתב. כן, שמעתם נכון. הוא מביא שם סיפור מעשיות על אלילי המצרים. האליל תחות - סליחה על ההגייה המעוותת מראש - האליל תחות מציע בפני מלך האלילים תאמוס כל מני המצאות שהוא רוצה לתת בידי בני האדם, וכך מופיע שם ביחס להמצאת הכתב:

“אך כשהגיעו אל אותיות הכתב, אמר תחות: ‘מלאכה זו, המלך, תהפוך את המצרים לחכמים יותר ותשפר את זיכרונם; שכן נמצא כאן הסם לזיכרון ולבינה’.

ענה לו תאמוס: ‘תחות, רב-אמן שכמותך, אין אביה או ממציאה של מלאכה בהכרח השופט הטוב ביותר באשר לתועלת או לנזק שתביא המצאתו למשתמשים בה. והנה כעת, אתה, אבי הכתב, מתוך חיבת אב ליציר כפיך, ייחסת לו סגולה שאינו יכול להחזיק בה; שכן המצאה זו תוליד שכחה בנשמות הלומדים, משום שיזניחו את זיכרונם; מתוך שיבטחו בכתב, ייזכרו בדברים לא מכוח עצמם, מבפנים, אלא מכוחם של סימנים זרים, מבחוץ. לא סם לזיכרון מצאת, כי אם סם להיזכרות, ולתלמידיך אתה נותן לא אמת, אלא רק מראית עין של אמת; הם יהיו שומעים דברים הרבה אך לא ילמדו דבר; הם ייראו כיודעי-כל בעוד שבאופן כללי לא ידעו דבר; להיות בחברתם תהיה חוויה מעיקה, שכן יחזיקו במראית עין של חוכמה ללא המציאות שלה’.”

נשמע מוכר, נכון? אפשר לדמיין בדיוק את אותו הדיאלוג היום סביב ה-AI, כמו שלפני כמה שנים אפשר היה לחשוב על הדיאלוג הזה סביב טכנולוגיית החיפוש באינטרנט. ושמעו, אולי את האינטרנט תהיו מוכנים לסגור כדי לעודד התפתחות אישית, אבל כתיבה? האם אנחנו סבורים שבסה”כ הכולל היה עדיף שהאנושות לא תמציא את הכתב, מתוך חשש שהמוח האנושי יאבד את יכולות הזיכרון שלו? ברור שלא. ברור לנו שיכולות הזיכרון שלנו אולי נחלשו, אבל בסך הכולל אנחנו הרווחנו מהמצאת הכתב.

מה שחשוב כאן איננו שנשמר את כל היכולות שהיו לנו באותה רמה. גם ראש צוות בהייטק מחליד כשהוא לא כותב קוד במשך תקופה. הדגש כאן הוא לוודא שכאשר אנחנו נאבד את היכולות הללו, זה יהיה באופן טבעי כתוצאה מהצרכים הקונקרטיים של המציאות שסביבנו, ולא בגלל איזו אמונה עקרונית שאין כבר ערך בידע הרחב שצברנו כחברה.

האמת היא שהיום, אחת הסכנות שאורבות לפיתחנו הוא שהיום אנחנו נהנים משני העולמות. GPT יצא לפני כשלוש שנים, ורוב האנשים בשוק העבודה הם כאלו שבנו את כל התשתית החינוכית שלהם הרבה לפני כן. מה שאנחנו חווים כיום הוא בדיוק מה שקורה כאשר אנשים עם ידע וניסיון משתמשים בטכנולוגיה שיכולה להעצים אותם. אבל אם נקבל את גישתם של “מפלגת המחשבות” ונאמין שאין ל-IQ שלי כל השפעה על ההצלחה שלי בעתיד, אנחנו נייחס את הטוב של היום ל-AI במקום לבני האדם שמתשמשים בו, וקל לחזות שדור העתיד יהיה רדוד בהרבה, ואיתו גם ירדו הדיווידנדים שה-AI הציע לנו. הדברים אמורים בכל הרמות - גם בגלל שמינוף ה-AI לא ימצה את הפוטנציאל שלו, וגם בגלל שהתוצרים שאנחנו נייצר, אלו שיכנסו לקורפוס האימון הבא של ה-AI, יהיו בעלי איכות ירודה. הדברים מזכירים את הציטוט הידוע של הסופר מיכאל הופף,

“Hard times create strong men. Strong men create good times.

Good times create weak men. And, weak men create hard times.”

ובעברית:

“תקופות קשות מייצרות אנשים חזקים, אנשים חזקים מייצרים תקופות טובות.

תקופות טובות מייצרות אנשים חלשים, ואנשים חלשים מייצרים תקופות קשות”.

הדברים הם בידינו, ביד כל אחד ואחת מאיתנו. אם נחליט להמשיך לקרוא, ליצור בידיים, לכתוב מאמרים ולסגנן פודקאסטים ולכתוב מוזיקה בעצמנו, ואם נדאג שכך יהיה עם הילדים שלנו - הרי שגם הדור הבא יהיה עשיר ברוחו, ומתוך כך יוכל להפיק המון מתוך השימוש ב-AI. וזה די מדהים, לפעמים, כמה אפילו אנשים בודדים יכולים להשפיע למרחוק על החברה כולה, אז אל תזלזלו בהשפעה שיש לכם על הכלל. אנחנו בדור הרשתות, ורעיון טוב או תובנה עמוקה יכולים להתפשט כאש בשדה קוצים. הרעיון שאנשים מאזינים היום לפודקאסטים של מספר שעות רק מדגים את הצימאון האנושי לתוכן ומשמעות. אז באמת, תתחילו מקומית ואל תתייאשו. כפי שכבר נאמר - מעט מן האור דוחה הרבה מן החושך.

וזהו להיום! יש לי כמה סגירות אחרונות לפני סוף העונה. אני חושב שהפרק הבא הוא הפרק האחרון, אבל - עד שזה לא מסתיים זה לא מסתיים! יש המון חומר שמעולם לא נכנס לעונה, כזה שיצטרך לנוח בבויידעם אם אני לא אכניס אותו כאן, אז אולי תנוח עלי הרוח להוסיף אותו לפני שנסגור אותה סופית! נחכה ונראה…

להתראות, ביי…